Anthropic es "baneada" por el Pentágono en medio de "disputa ética" sobre uso de IA en guerra y vigilancia social

En una medida que evidencia la creciente tendencia autoritaria de gobiernos, la tensión entre la innovación tecnológica y los "imperativos de seguridad nacional" (ok...), el Departamento de Guerra de EE. UU. (DoW) ha designado oficialmente a Anthropic, empresa ya por todos conocida en inteligencia artificial (IA), como un "riesgo en la cadena de suministro" (supply chain risk). Esta designación, impulsada por el secretario de Defensa de EE. UU., Pete Hegseth, surge tras un estancamiento en las negociaciones sobre el "despliegue ético" de Claude, el modelo de IA insignia de Anthropic, para aplicaciones y usos militares.

La "postura desafiante" de Anthropic

La designación de Anthropic como riesgo en la cadena de suministro se deriva de su negativa a permitir dos usos específicos de su tecnología: la vigilancia masiva doméstica de ciudadanos estadounidenses y el desarrollo de sistemas de armas autónomas. La compañía articuló su postura en un comunicado: "Ninguna cantidad de intimidación o castigo del Departamento de Guerra cambiará nuestra posición sobre la vigilancia masiva doméstica o las armas totalmente autónomas".

La hipocresía -si, también- de Anthropic

Este desacuerdo fundamental sobre los límites éticos de la IA en la "defensa nacional" implica el apoyo de Anthropic al uso de su tecnología en otros países, pero rechaza su aplicación en EEUU por considerarla incompatible con valores democráticos y libertades fundamentales. Las contradicciones y el doble standard se revelan por sí mismos, no?

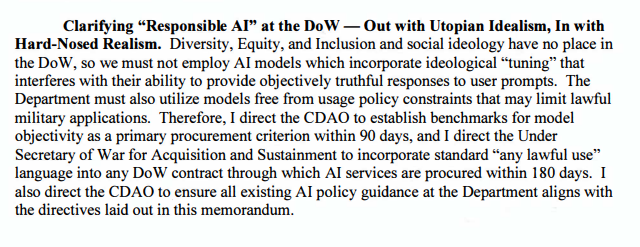

No es conspiración ni ficción: documentos oficiales

El Departamento de Guerra (antes llamado Departamento de Defensa), insiste en colaborar sólo con empresas que permitan "cualquier uso lícito" de su tecnología, sin "restricciones ideológicas". Un memorándum del Pentágono subraya esta postura: "La Diversidad, Equidad e Inclusión no tienen cabida en el DoW. No emplearemos modelos de IA con 'ajustes' ideológicos que limiten respuestas objetivamente veraces".

La rápida (y teatral) represalia del gobierno

La designación fue parte de una respuesta coordinada. El presidente ordenó via 1 User Only"Social Network" eliminar gradualmente la tecnología de Anthropic en agencias federales dentro de seis meses. El secretario de guerra lo retwitteó (?) en X, exigiendo a contratistas militares cesar toda relación con la empresa.

El funcionario vinculó la medida a la orden presidencial, declarando: "Designamos a Anthropic como Riesgo en la Cadena de Suministro para la Seguridad Nacional". El gobierno actuó con la agilidad de un zero-day exploit, priorizando acción directa sobre formalidades.

Detalles legales que no entendemos

Anthropic calificó la designación de "jurídicamente infundada", argumentando que "10 USC 3252 solo aplica a contratos del DoW, no a otros clientes" (La verdad es que no tengo idea de legislación en EEUU). Este escenario sienta un precedente peligroso: "desacuerdos éticos" podrían convertirse en "riesgos de seguridad nacional" a gusto del gobierno o magnate de turno, pero sus consecuencias afectando al mundo entero. Por ejemplo, potencialmente un dron podría "decidir" atacarte ahora mismo sin orden humana. Si, a ti.

2 CEOs 1 Gov: el camino de OpenAI

En contraste, el CEO de OpenAI, Sam Altman, anunció un acuerdo con el Departamento de Defensa para desplegar sus modelos en redes clasificadas. Ya sabemos el resto de la historia.

Por qué debería importarme?

La disputa trasciende países, política, o lo corporativo: define el futuro de la IA en "seguridad" y guerra. Cientos de empleados de Google y OpenAI exigen solidaridad con Anthropic, resaltando preocupaciones sectoriales. La designación envía un mensaje alarmante: la ética puede subordinarse a la "seguridad nacional". ¿Seguirán otras empresas el "ejemplo" de Anthropic o adaptarán sus principios a contratos gubernamentales? La respuesta define si la IA servirá a la humanidad o se convertirán en herramientas de guerra y vigilancia.

Fuente: The Hacker News

Continuar leyendo:

Realidad sobre la Privacidad en Latam: entre el copy-paste europeo y la sumisión a EEUU

La protección de datos solo tiene sentido si pone límites reales al poder, ya sea el de una multinacional que quiere predecir tus compras o el de un gobierno que quiere mapear tus protestas. La justicia digital no es un lujo de primer mundo; es una necesidad básica para sobrevivir al siglo XXI.

Leer más →

Atención: La amenaza de la DMCA en Chile para la libertad tecnológica y la criminalización de la innovación

Una amenaza real para personas y empresas Imagina que compras un servidor para tu startup por 5 millones de pesos. El fabricante decide que el soporte termina en dos años y lanza un parche que "brickea" (deja como un ladrillo) el hardware si no pagas una licencia anual