Kubernetes ahora tiene un Node Readiness Controller: porque "ready" es un término relativo

Node Readiness Controller permite definir scheduling gates personalizados.

Node Readiness Controller permite definir scheduling gates personalizados.

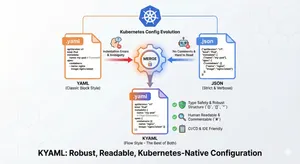

En la gestión operativa de Kubernetes, la definición de manifiestos ha oscilado históricamente entre dos extremos. Por un lado, YAML, el estándar de facto, ofrece legibilidad humana pero es intrínsecamente frágil debido a su dependencia de la indentación y la ambigüedad en el tipado de datos. Por otro lado, JSON,

Recientemente se ha incorporado un nuevo tipo de volumen al ecosistema de Kubernetes: el volumen image. Esta funcionalidad, disponible a partir de la versión 1.35.0 y actualmente en fase beta, promete cambiar la forma en que gestionamos los datos estáticos y configuraciones en nuestros clústeres. La relevancia de

Cómo migrar desde Ingress NGINX sin editar tus actuales manifiestos? Traefik 3.5 presenta un Ingress Provider compatible con ingress-nginx, permitiendo migrar sin reescribir tus manifiestos existentes.

La CNCF ha declarado oficialmente a Knative como listo para producción. Prometen menos dolores de cabeza con YAML, más fooco en "event driven" y, quizás, ahorres algunos centavos en el billing de tu señor feudal en la nube favorito.

Microsoft ha lanzado oficialmente la disponibilidad general de Azure Kubernetes Service (AKS) Automatic, una nueva oferta completamente administrada diseñada para enfrentar la bestia operativa que es Kubernetes, permitiéndote enfocarte en tus aplicaciones en lugar de pelearte con la configuración del clúster. En esencia, Microsoft está ofreciendo pagar lo que llama

Seamos sinceros: desplegar modelos de IA a escala es un dolor de cabeza. KServe llega para simplificarlo. ¿Qué es KServe? KServe es una plataforma de inferencia de modelos de machine learning construida sobre Kubernetes. Permite desplegar modelos de manera eficiente, escalable y reproducible. ¿Por qué elegir KServe? (Porque lo tienes

Es GitOps, impulsado por el Kubernetes Resource Model (KRM), gestionando todo: desde deployments hasta IAM, DNS, bases de datos SQL gestionadas y reglas de firewall — con una única API, un único modelo y una única fuente de verdad en Git.

¿La idea central? Tomar los patrones probados en batalla del mundo cloud-native – específicamente, imágenes base inmutables del SO construidas como contenedores – y aplicarlos al escritorio. Es ospechosamente como alguien intentando arreglar el escritorio Linux... otra vez. Pero esperen, esta vez involucra contenedores, palabras de moda cloud-native, y una dosis saludable

En simple: Es una nueva forma de dónde y cómo se procesa el código fuente, moviendo la carga desde cloud instances (o servidores, etc) hacia el navegador del usuario final a través de "micro sandboxes" que compilarán la app.

Combinamos métodos Site Reliability Engineering, DevOps, y DevSecOps, junto a sólida formación técnica, continua y colectiva, que busca entregar valor a través del análisis sistémico.